Microsoft exec, AI kontrol altında tutulmazsa Orwellian bir gelecek bekleyin diyor

Microsoft Başkanı Brad Smith'e göre, halkı korumaya yönelik yasalar yakında çıkarılmazsa, yapay zeka Orwellvari bir geleceğe yol açabilir.

Smith, 26 Mayıs'ta BBC haber programı ‘Panorama’ya yapay zekanın (AI) potansiyel tehlikelerine ve ABD ile Çin arasındaki teknolojiyi geliştirme yarışına odaklanan bir bölümde açıklamalarda bulundu. Uyarı, Avrupa Birliği'nin AI'nın nasıl kullanılabileceğine dair sınırlar koymaya çalışan taslak yönetmelikleri yayınlamasından yaklaşık bir ay sonra geliyor . Mevzuatın büyük ölçüde düzenlemeleri sınırlamaya ve ulusal güvenlik amaçları için AI'yı teşvik etmeye odaklandığı Amerika Birleşik Devletleri'nde benzer çabalar çok azdır.

SenseTime Group Ltd.'nin CEO'su Xu Li, 15 Haziran 2018'de şirketin Pekin, Çin'deki showroom'unda AI şirketinin yüz tanıma sistemi tarafından tanımlandı.

Smith, "George Orwell'in '1984' adlı kitabındaki dersleri sürekli hatırlatılıyor" dedi. "Temel hikaye, herkesin yaptığı her şeyi görebilen ve herkesin her zaman söylediği her şeyi duyabilen bir hükümetle ilgiliydi. Bu 1984'te gerçekleşmedi, ama eğer dikkatli olmazsak, bu gerçekleşebilirdi. 2024'te."

Karanlık tarafı olan bir araç

Yapay zeka tam olarak tanımlanmamış bir terimdir, ancak genellikle bir insan operatör tarafından yönlendirilmeden sorunları otomatik olarak öğrenebilen veya çözebilen makinelere atıfta bulunur. Günümüzde pek çok AI programı, büyük miktarda verideki kalıpları tanımak ve ardından bu dersleri bir sonraki veri turuna uygulamak için kullanılan bir hesaplama yöntemleri paketi olan makine öğrenimine güveniyor ve teorik olarak her geçişte daha doğru hale geliyor.

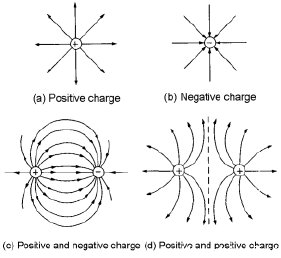

Bu kadar her şeyi uygulanmış son derece güçlü bir yaklaşımdır temel matematiksel teoriye göre evrenin ilk simülasyonları ama sosyal verilere uygulanması durumunda tehlikeli olabilir, uzmanlar savunuyorlar. İnsanlarla ilgili veriler, insan önyargılarıyla önceden yüklenmiş olarak gelir. Örneğin, JAMA Psychiatry dergisinde yakın zamanda yapılan bir araştırma, intihar riskini tahmin etmeye yönelik algoritmaların, kısmen tıbbi sistemde daha az renkli hasta olması ve kısmen de siyah ve Amerikan Kızılderili/Alaska Yerli bireylerde beyaz bireylere göre çok daha kötü performans gösterdiğini buldu. çünkü beyaz olmayan hastaların ilk etapta tedavi ve uygun tanı alma olasılıkları daha düşüktü, bu da orijinal verilerin risklerini hafife almak için çarpıtıldığı anlamına geliyordu.

Yapay zeka ve etik üzerine profesyonel bir kurs veren Massachusetts Institute of Technology'de kimya mühendisliği profesörü Bernhardt Trout, önyargıdan asla tamamen kaçınılamaz, ancak ele alınabilir, dedi. Trout, WordsSideKick.com'a verdiği demeçte, iyi haber, önyargıyı azaltmanın hem akademi hem de AI endüstrisinde en önemli öncelik olmasıdır.

"İnsanlar toplumda bu konunun çok farkında ve bu sorunu çözmeye çalışıyorlar" dedi.

Devlet gözetimi

Trout, AI'nın kötüye kullanımının belki de daha zorlayıcı olduğunu söyledi. Yapay zekanın nasıl kullanıldığı sadece teknik bir konu değildir; bu aynı derecede politik ve ahlaki bir soru. Ve bu değerler ülkeden ülkeye büyük farklılıklar göstermektedir.

Smith, "Yüz tanıma, bazı yönlerden iyi şeyler yapmak için olağanüstü güçlü bir araçtır, ancak bir sokaktaki herkesi izlemek istiyorsanız, bir gösteriye gelen herkesi görmek istiyorsanız, yapay zekayı işe koyabilirsiniz" dedi. BBC. "Ve bunu dünyanın belirli yerlerinde görüyoruz."

Çin, yapay zeka teknolojisini hem sıradan hem de endişe verici şekillerde kullanmaya başladı bile. Örneğin bazı şehirlerde otobüs ve trenlerde bilet yerine yüz tanıma kullanılıyor. Ancak BBC'nin "Panorama" raporuna göre, bu aynı zamanda hükümetin vatandaşların hareketleri ve etkileşimleri hakkında bol miktarda veriye erişimi olduğu anlamına geliyor. Video gözetim etiğine odaklanan ABD merkezli savunuculuk grubu IPVM, Çin'de her sakinin faaliyetlerini, ilişkilerini ve siyasi inançlarını bir hükümet dosyasında toplayacak "Bir kişi, bir dosya" adlı bir sistem geliştirme planlarını öneren belgeler buldu. .

IPVM direktörü Conor Healy BBC'ye verdiği demeçte, "Orwell'in bir hükümetin bu tür bir analiz yapabileceğini hayal edebileceğini sanmıyorum" dedi.

Orwell'in ünlü romanı "1984", hükümetin vatandaşları evde bile "teleekranlar" aracılığıyla izlediği bir toplumu anlatıyordu. Ancak Orwell, yapay zekanın gözetime katacağı yetenekleri hayal etmedi - romanında karakterler video gözetiminden kaçınmanın yollarını buluyor, ancak vatandaşlar tarafından teslim ediliyor.

BBC , Uygur azınlığın Çin hükümetini işkence ve kültürel soykırımla suçladığı Xinjiang'ın özerk bölgesinde, insanları izlemek ve hatta tutuklanıp sorguya çekildiklerinde suçluluklarını değerlendirmek için yapay zekanın kullanıldığını tespit etti. Bu, yaygın insan hakları ihlallerini kolaylaştıran teknolojinin bir örneğidir: Dış İlişkiler Konseyi, 2017'den beri bir milyon Uygur'un, tipik olarak herhangi bir suçlama veya yasal kaçış yolu olmaksızın "yeniden eğitim" kamplarında zorla gözaltına alındığını tahmin ediyor.

Geri itmek

AB'nin potansiyel AI düzenlemesi, kullanıcıların özgür iradesini aşmaya çalışan sistemleri veya hükümet tarafından her türlü "sosyal puanlamayı" sağlayan sistemleri yasaklayacaktır. Diğer uygulama türleri "yüksek riskli" olarak kabul edilir ve piyasaya sürülmek için şeffaflık, güvenlik ve gözetim gereksinimlerini karşılamalıdır. Bunlar, kritik altyapı için AI, kanun yaptırımı, sınır kontrolü ve yüz veya ses tanımlama sistemleri gibi biyometrik tanımlama gibi şeyleri içerir. Müşteri hizmetleri sohbet robotları veya AI özellikli video oyunları gibi diğer sistemler düşük riskli olarak kabul edilir ve sıkı incelemeye tabi değildir.

ABD federal hükümetinin yapay zekaya olan ilgisi, aksine, büyük ölçüde ulusal güvenlik ve askeri amaçlar için yapay zekanın gelişimini teşvik etmeye odaklandı. Bu odak zaman zaman tartışmalara yol açmıştır. Örneğin 2018'de Google, askeri uçaklar ve insansız hava araçları tarafından çekilen videoları otomatik olarak analiz edecek olan Pentagon ile bir sözleşme olan Maven Projesi'ni sonlandırdı. Şirket , amacın yalnızca nesneleri insan incelemesi için işaretlemek olduğunu savundu , ancak eleştirmenler, teknolojinin insanları ve yerleri drone saldırıları için otomatik olarak hedeflemek için kullanılabileceğinden korkuyordu. Google'daki muhbirler projeyi gün ışığına çıkardı ve sonuçta şirketin çabayı durdurduğu kadar güçlü bir kamuoyu baskısına yol açtı.

Bununla birlikte, Trout , Pentagon'un yapay zeka sözleşmelerine yılda 1 milyar dolardan fazla harcama yaptığını ve Çin'in yapay zeka üstünlüğü elde etme konusundaki coşkusu göz önüne alındığında, makine öğreniminin askeri ve ulusal güvenlik uygulamalarının kaçınılmaz olduğunu söyledi.

Trout, WordsSideKick.com'a “Yabancı bir ülkenin bu teknolojileri geliştirme arzusunu engellemek için fazla bir şey yapamazsınız” dedi. "Ve bu nedenle, yapabileceğiniz en iyi şey, ahlaki lider olurken onları anlayabilmek ve kendinizi koruyabilmek için onları kendiniz geliştirmektir."

Bu arada, yerel olarak yapay zekayı dizginleme çabaları eyalet ve yerel yönetimler tarafından yürütülüyor. Washington eyaletinin en büyük ilçesi King County, hükümetin yüz tanıma yazılımı kullanmasını yasakladı . ABD'de bunu yapan ilk ilçe, ancak San Francisco şehri 2019'da aynı hamleyi yaptı ve ardından bir avuç başka şehir geldi.

Zaten, sahte tutuklamalara yol açan yüz tanıma yazılımı vakaları oldu. Haziran 2020'de Detroit'te bir Siyah adam, bir algoritma tarafından yanlışlıkla bir hırsızlık davasında şüpheli olarak tanımlandığı için tutuklandı ve 30 saat gözaltında tutuldu. Ulusal Standartlar ve Teknoloji Enstitüsü tarafından 2019 yılında yapılan bir araştırma , yazılımın Siyah ve Asyalı bireyler için beyaz bireylere kıyasla daha fazla yanlış eşleşme döndürdüğünü buldu; bu, teknolojinin beyaz olmayan insanlar için polislikteki eşitsizlikleri derinleştirmesi muhtemel olduğu anlamına geliyor.

Smith, "Gelecekte halkı koruyacak yasaları şimdi yürürlüğe koymazsak, teknolojinin hızla ilerlediğini göreceğiz" dedi ve "bunu yakalamak çok zor olacak."