AI algoritmaları hiç etik olabilir mi?

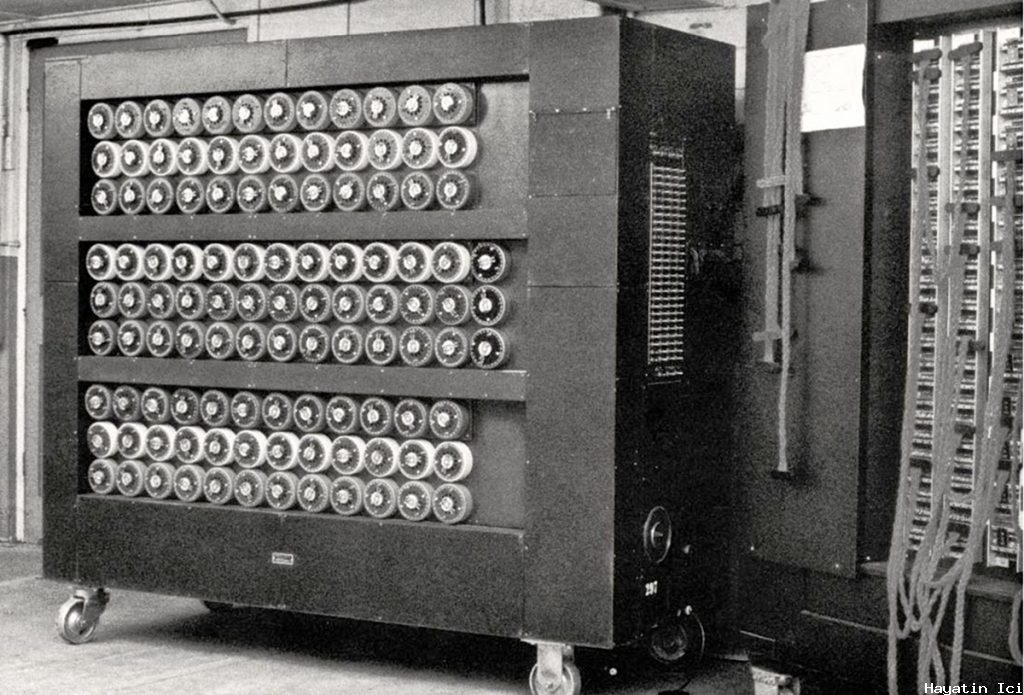

Dünyanın her yerindeki, 4 milyardan fazla çevrimiçi olan insanlar artık siber uzayın ve sosyal medyanın tehlikelerine uyandılar. Bu ikna güçlerini yönlendirmeyi ve politikalarımıza egemen olan propagandanın şifresini çözmeyi öğrenebilir miyiz? Hayatlarımız üzerindeki kararların nasıl büyük veriye, otomasyona ve bilgisayar programlarına devredildiğini düzenleyebilir miyiz? Gizli algoritmaları izleyebilir, matematikte saklı varsayımlarını ortaya çıkarmaya zorlayabilir miyiz?

Bu karar verme algoritmalarını tasarlayan birçok uzman, bilgi uçuran kişiler haline geldi. Cathy O'Neal, Weapons of Math Destruction'da (2017) kimin üniversitelere gireceğine, kimlerin hangi işleri alabileceğine, kimlerin hapse girebileceğine veya kefaletle serbest bırakılacağına, kimlerin sağlık sigortasından mahrum bırakılacağına veya sağlık sigortasından mahrum bırakılabileceğine algoritmaların nasıl karar verdiğini açıklıyor. oy hakkı! Davalar artık insanları ırk, cinsiyet veya ten rengine göre değersizleştiren önyargılı algoritmalara meydan okuyor. ABD merkezli Wilson Merkezi, şok edici araştırmaya sponsor oldu Malign Yaratıcılık: Cinsiyet, Cinsiyet ve Yalanlar Çevrimiçi Kadınlara Karşı Nasıl Silahlanıyor?, kamu görevlerinde bize hizmet eden kadınların sosyal medya platformlarında cinsiyetçi, ırkçı tehditler ve karalamalarla nasıl taciz edildiğini ve saldırıya uğradığını inceliyoruz. Bu tür kadın düşmanlığı sadece gazetecileri değil, Kongre üyelerini, valileri ve hatta Başkan Yardımcımızı da etkiliyor. Bu kanıtlar üzerine sosyal medya platformlarının daha hesap verebilir hale getirilmesi için öneriler sunulmaktadır. Bunlar, Facebook'ta bir yatırımcı olan eski içeriden Roger McNamee kadar ileri gitmiyor: kâr amacı güden algoritmalarını tasarlayan tüm yöneticileri, bilim adamlarını ve psikologları kişisel olarak sorumlu tutuyor. Bu, komplo gruplarına katılan sayıları şişiren algoritmik önerilerdeki rollerini içerir. McNamee, Facebook'un "tavsiye" algoritmasının 2 milyona kadar insanı tarikat QAnon'a katılmaya sürüklediğini belirtiyor.

Daha da rahatsız edici olan, bu algoritmaların birçoğunun etik olmayan davranış psikologları tarafından para kazanmak ve kullanıcıları “tıklama tuzağı” ile ekranlarına bağımlı kılmak için tasarlandığı gerçeğidir. Bugün hepimiz Sıradan Ülkelerde ve Dikkat Ekonomilerinde yaşıyoruz ve sosyal medya şirketleri, Facebook, Twitter, YouTube, Google ve diğerleri tarafından kullanılan algoritmalar, kullanıcıların dikkatini çekmek ve ardından kişisel bilgilerini reklamcılara, veri komisyoncularına, sigortacılara satmak için tasarlanmıştır. ve diğer şirketler. Google ve diğer BT şirketlerinin hükümetlerin devralmalarını sübvanse etmesini talep etmesiyle birlikte, on yıllık bir yutturmaca sürücüsüz arabaları teşvik etti. In Hayalet Yolu, şehir plancısı Anthony Townsend, algoritmaların ve sensörlerin birçok trafik durumunu tehlikeli bir şekilde tanıyamadığını kanıtladığı ve bunun ölümlere ve yaralanmalara neden olmaya devam edeceğinden, arabaların asla tam otomatik olamayacağı gerçeğini ortaya koyuyor.

“Yapay Zeka” teriminin kendisi, daha yakından incelemeyi ve anlamayı korkutan gizemli bir slogandır. Bu algoritmalarda yapay hiçbir şey yoktur. Hepsi insanlar tarafından eğitilmeli ve onların görüşlerini ve önyargılarını yansıtmalıdır ve Makineleri Eğitmeden Önce İnsanları Eğitelim bölümünde açıkladığım gibi, insan tarafından eğitilmiş makine öğrenimi programları olarak tanımlanmalıdır . Shoshana Zuboff tüm bu konuları The Age of Surveillance Capitalism (2019) kitabında özetliyor ; Rana Foroohar, Don't Be Evil'de (2019) Google'ın genç kurucularının etiğinin, Google'ı reklamverenler olarak baskın Silikon Vadisi sosyal medya iş modeline iten açgözlü Silikon Vadisi girişim kapitalistleri tarafından nasıl altüst edildiğini anlatıyor .

ABD Capitol'deki 6 Ocak 2021 ayaklanması, bu güçlü ikna araçlarının tüm bu sorunlarını ve demokrasiler için oluşturduğu tehdidi ön plana çıkardı. In Dijital Çağda Challenged Demokrasinin Geleceği , ben Facebook Malezya'da Rohingyalılarla, Hindistan'da etnik gerilime, Filipinler ve Yeni Müslümanların toplu katliamı dahil körüklemek Nefret gruplarını, teröristleri ve azınlıkların zulüm, nasıl yardım ettiğini özetlenen Zelanda. Başta Facebook olmak üzere bu dev sosyal medya platformlarının yöneticilerinin artık onları yönetemediği ve kontrol edemediği ortaya çıktı. Sosyal Medyayı Akıl Sağlığına Yönelik Yönlendirme bölümünde özetlediğim bu medya tekellerini düzenlemeye yönelik 5 adım :

- sorumluluktan korunmalarını sona erdirmek;

- onları antitröst kurallarına göre bölmek;

- kullanıcılarının anonimliğini sona erdirmek;

- “kamusal meydan” olduğu iddia edilen sosyal medya platformlarının kamu düzenlemesi altına alınması, gözetim altına alınması ve kâr amacının sınırlandırılması;

- Avrupa Birliği'nin Genel Veri Koruma Yönetmeliği'nde (GDPR) olduğu gibi kullanıcılara kişisel verileri üzerinde haklar verilmesi. Bu insan hakkının, habeas corpus hakkını ilan eden 1215 tarihli Magna Carta'nın yerleşik İngiliz hukukuna dayandırılmasını önerdim. Bu, kişinin vücuduna sahip olma hakkını garanti eder. Bugün bunu, kişinin beynine ve ürettiği bilgilere sahip olma hakkını, tanıtımını yaptığımız yeni bir Bilgi Habeas Corpus'u kapsayacak şekilde genişletmemiz gerekiyor.

Daha büyük soru şu: İnsan tarafından eğitilmiş algoritmalar hiç etik olabilir mi? Yakın tarihli iki kitap bu konuları araştırıyor: Michael Kearns ve Aaron Roth tarafından yazılan The Ethical Algorithm (2019) ve Human Uyumlu(2019), Stuart Russell tarafından. Temel sorunlar arasında “Kral Midas” sorunu yer alır: Bir algoritma, ister ataç üretimini denetlerken, isterse başka herhangi bir kararda olsun, kesin bir görevi yerine getirmek için çok dar bir şekilde eğitildiğinde, programı insan kontrolünün ötesinde devam edecektir. Bir de “Goril sorunu” var: Tıpkı biz insanların goriller gibi diğer türlerin yok olmasına neden olduğumuz gibi, algoritmalar da kendilerini insanlardan daha akıllı olacak şekilde eğitebilir ve goriller kadar tehlikede oluruz. Çoğu uzman, insanların onları devre dışı bırakacak bilgiye sahip olmaması durumunda kendilerini güvenli bir şekilde kapatmak için tüm algoritmaların gömülü bir öldürme anahtarına sahip olması gerektiği konusunda hemfikirdir. Yine de uzmanlar, algoritmaların bu öldürme anahtarlarını nasıl devre dışı bırakacağını da öğrenebileceğini kabul ediyor!

Yani sorun devam ediyor. Bazıları hala insanların etiği algoritmalara dönüştürerek onları “Tasarımla Güvenilir” hale getirebileceğine inanıyor olsa da, Building Trust in AI ve ML (Forum Avrupa için Workday, Inc tarafından hazırlanan teknik inceleme). Diğerleri o kadar emin değil. Danışma Kurulumuzdaki uzman Dave Lauer , Etik olmadan AI etiğine sahip olamazsınız . Herhangi bir algoritmayı çalıştıran herhangi bir şirket veya kuruluşun, kendisini kamuya karşı sorumlu tutmak için sağlam, şeffaf bir etik kurallarına sahip olması gerektiği konusunda uyarıyor. Dünya Akademiçevrimiçi Sanat ve Bilim küresel tartışma Şubat onun Paneli içinde 2021 tartışmaktadır bütün bunlarla eş sponsorluğunda Etik Pazarlarda Medyanın Sorumlulukları ve Bilginin Geleceği Üzerine. Forum Europe'un “Küresel bir Güven Eko-Sistemi Geliştirmek Yapay Zeka Yönetimi” konulu Ocak 2021 web semineri, kaçınılmaz, karlı yapay zeka geleceğine ilişkin küresel endüstri görüşünü teşvik ediyor. Geri kalanımız onlara güvenmeye ikna ediliyoruz. Bizi izlemeye devam edin!